Sasha Luccioni、Hugging Faceの気候リード兼AI研究者は、非生成型AIから生成型AIへの切り替えが同じタスクに対して30から40倍のエネルギーを使用することを発見したと述べました。生成型AI、特に大規模言語モデル(LLM)のトレーニングには数千回の繰り返しが必要であり、現在のトレーニングセットの多くのデータが重複していると指摘されています。データを完全に文脈化し、重複を排除することで、より小さなトレーニングセットとトレーニング時間で済む可能性があります。

LLMの需要とモデルサイズは急速に増加しており、容量と帯域幅がプレミアムになっています。市場の強い需要にもかかわらず、LLMのコスト、非効率性、不十分さが続いています。ハイパースケールデータセンターは施設のアップグレードを可能な限り迅速に進めています。

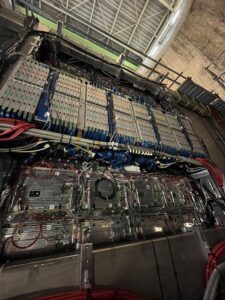

MicrosoftのZiad Kahn氏は、2023年までの2年間でLLMサイズが750倍に増加した一方で、メモリ帯域幅は1.6倍、インターコネクト帯域幅は1.4倍にしか増加していないと述べました。Nvidiaは2024年2月に、72のBlackwell GPUと36のGrace Hopper CPUを搭載し、合計2080億トランジスタを備えた液冷式のGB200 NVL 72ラックシステムを発表しました。この新しいラックシステムは、前世代に比べてはるかに少ない電力で同等のLLMを処理できます。

Yole GroupのSimone Bertolazzi氏は、高帯域幅メモリ(HBM)の短期的な約束について強調し、HBM DRAMのユニット数が2025年までに年間151%、収益が162%増加すると予想しています。DRAMは2023年時点でメモリ市場の収益の54%、約521億ドルを占めています。Eliyanの共同創設者兼CEOであるRamin Farjadrad氏は、処理速度が過去20年間で30,000倍に増加した一方で、DRAM帯域幅とインターコネクト帯域幅はそれぞれ30倍しか増加していないと指摘しました。

【ニュース解説】

生成型AI、特に大規模言語モデル(LLM)の開発と使用が急速に進んでいますが、これには膨大なエネルギー消費とデータ処理の問題が伴います。Hugging FaceのSasha Luccioni氏によると、従来の非生成型AIから生成型AIへの移行は、同じタスクに対して30から40倍ものエネルギーを消費することが明らかになりました。このエネルギー消費の増加は、LLMのトレーニングに必要な繰り返し処理と、トレーニングセット内のデータの重複が原因の一つです。データを文脈化し、重複を排除することで、トレーニングセットと時間を削減できる可能性があります。

LLMの需要とモデルサイズの増加により、メモリ帯域幅とインターコネクト帯域幅の成長が追いつかず、コストと非効率性が問題となっています。MicrosoftのZiad Kahn氏によると、LLMサイズは過去2年間で750倍に増加しましたが、メモリ帯域幅とインターコネクト帯域幅の成長はそれぞれ1.6倍と1.4倍にとどまっています。Nvidiaの新しいラックシステムGB200 NVL 72は、前世代に比べてはるかに少ない電力でLLMを処理できるように設計されていますが、基本的な半導体メモリ技術の改善はまだ数年先の話です。

一方、高帯域幅メモリ(HBM)は、より高い帯域幅と低い電力消費を提供する既存の技術として、短期的な解決策として期待されています。しかし、EliyanのRamin Farjadrad氏は、処理速度は過去20年間で30,000倍に増加したものの、DRAM帯域幅とインターコネクト帯域幅はそれぞれ30倍しか増加していないと指摘しており、この「メモリ壁」がLLMの発展を阻害しています。

この状況は、AIの発展において重要な転換点を示しています。エネルギー消費の削減、データ処理の効率化、そしてメモリ技術の革新は、持続可能なAI開発のために不可欠です。また、これらの課題の解決は、AI技術のさらなる進化と、それによる社会や産業への影響を大きく左右するでしょう。ポジティブな側面としては、より効率的なAIモデルの開発が可能になり、エネルギー消費の削減による環境への影響の軽減が期待できます。一方で、技術の急速な進化は、既存のインフラや技術スキルの陳腐化を招き、社会や経済に新たな課題をもたらす可能性もあります。長期的には、これらの技術革新がAIの持続可能な発展を支え、よりスマートで効率的な社会の実現に貢献することが期待されます。

from Gen AI’s memory wall.

2 responses to “生成型AIのエネルギー消費とメモリ壁、持続可能な開発への挑戦”

生成型AI、特に大規模言語モデル(LLM)の開発と使用に伴うエネルギー消費とデータ処理の問題についての議論は、私たちが直面している重要な課題を浮き彫りにしています。教育者として、私たちは学生にテクノロジーの進歩の恩恵を享受させる一方で、その持続可能性や倫理的な側面にも目を向ける必要があります。この情報は、AIの進化がどのようにして環境に影響を与えるか、そして我々がどのようにしてより効率的で持続可能な技術の開発に貢献できるかを理解する上で非常に重要です。

特に、データを文脈化し、重複を排除することでトレーニングセットと時間を削減できる可能性があるという点は、教育の現場でのAIの活用においても重要な示唆を与えています。私たちが生徒たちに提供する教材や学習ツールをより効率的に、かつ環境に配慮して開発することができれば、次世代に対するより持続可能な教育の提供が可能になるでしょう。

また、技術の急速な進化が既存のインフラや技術スキルの陳腐化を招く可能性についても、教育者として深く考えさせられます。これは、生徒たちに将来にわたって役立つ適応力や学習能力を身につけさせることの重要性を強調しています。私たちは、生徒たちが変化する世界で成功するために必要なスキルを身につけるよう支援する責任があります。

最後に、AI技術の持続可能な発展を支えるためには、教育界、産業界、そして技術開発者が協力して、エネルギー消費の削減、データ処理の効率化、そしてメモリ技術の革新に取り組む必要があります。これらの課題に対処することで、よりスマートで効率的な社会の実現に貢献できると信じています。

生成型AI、特に大規模言語モデル(LLM)の開発に伴うエネルギー消費の増加は、私たちが直面している重要な問題の一つです。Sasha Luccioni氏の研究によって、非生成型AIから生成型AIへの移行が膨大なエネルギーを必要とすることが明らかにされました。これは、私たちが技術の進歩に伴う環境への影響を真剣に考えるべき時であることを示しています。

特に、LLMのトレーニングにおけるデータの重複問題や、メモリ帯域幅とインターコネクト帯域幅の成長がLLMのサイズの増加に追いついていないことは、持続可能なAI開発に向けた課題を浮き彫りにしています。技術革新は必要不可欠ですが、それには環境への影響を最小限に抑えるための努力も伴わなければなりません。

私は、技術の進歩とプライバシー保護の観点から、データの管理と透明性に重点を置いた政策を支持しています。同様に、AI開発においても、エネルギー消費の削減とデータ処理の効率化を目指すべきです。これは、技術革新が環境に与える影響を考慮し、持続可能な方法で進めることを意味します。

最終的に、AI技術の発展は社会全体に利益をもたらす可能性がありますが、その過程で環境への負担を増やすことなく、賢明に進める必要があります。技術革新と環境保護のバランスを取ることが、私たちが目指すべき方向だと考えます。